추천 콘텐츠

지금까지 우리는 딥페이크의 폭력적인 얼굴에 주목했다. 하지만 그것이 딥페이크의 전부일까? 딥페이크에 다른 면모는 없을까? 이 장에서는 딥페이크를 긍정적으로, 창의적으로 활용한 사례들을 집중적으로 살펴본다.

2018년 프랑스 출신 비디오 아티스트 조셉 아이얼(Joseph Ayerle)은 〈Un’emozione per sempre 2.0〉[1]이라는 4분 30초 남짓 길이의 영상을 발표했다. 1980년대 관능미로 주목받았던 이탈리아 여배우 오르넬나 무티(Ornella Mutti)가 주인공이다. 작품의 전반 2분가량은 그녀의 매력이 잘 드러나는 1970~1980년대 출연작의 장면들이 편집돼 흐른다. 이어 잠시 지직거리는 화면과 1인칭 시점에서 지하철 터널을 빠르게 달리는 장면이 지나가더니 이내 현재의 화려한 거리 모습과 함께 오르넬나 무티의 이미지가 다시 나타난다. 무티는 오늘날 뉴욕이나 파리의 패션쇼에서 볼 법한 화려하면서도 세련된 옷을 입고 있지만, 그녀의 얼굴이나 몸에서 세월의 흔적은 전혀 느낄 수 없다. 영상은 다시 30여 년 전 출연작 속 그녀의 모습과 아이폰, 패션잡지 《보그(Vogue)》 등 현재의 물건과 매치된 21세기 무티의 모습을 교차해 보여준 후 마무리된다. 동영상의 제목인 ‘Un’emozione per sempre’은 ‘영원한 감동’이라는 뜻이다.

조셉 아이얼은 이 작품을 만들기 위해 딥페이크 기술을 적용했다. 영상 후반에 나오는 젊은 오르넬나 무티의 모습은 그녀의 얼굴과 현세대 미국의 인기 모델이자 인스타그램 스타인 켄달 제너(Kendall Jenner)의 몸을 각각 학습해 합성한 것이다. 영상 제작을 위해 사용된 사진은 2000장 정도며, 기계학습을 위한 라이브러리로는 구글의 텐서플로우를 활용했다.

작품 설명은 이렇다.

그녀는 돌아올 것입니다. 만약 우리가 시간 여행을 할 수 있다면 어떻게 될까요? 젊고 아름다운 이탈리아 여배우(오르넬라 무티)는 … (중략) … 이 선택지를 얻게 됩니다. 그렇게 섹시한 이탈리아 영화배우는 2018년으로 시간 여행을 떠납니다. 이 영화는 1980년대 분위기와 Z세대 스타일의 충돌이며 우리 자신에 대해 이야기합니다. 자가 학습 인공신경망(AI)을 사용한 덕분에 이번 시간 여행은 할리우드 영화 규모의 예산을 들이지 않고 실현됐습니다. AI는 오르넬라 무티의 얼굴을 계산해 인스타그램 스타 켄달 제너의 몸에 합성(mapping)했습니다.[2]

사실 오르넬라 무티의 얼굴과 제너의 몸이 합성된 장면이 작품 전체에서 차지하는 비중이 10퍼센트도 안 되기 때문에 〈Un’emozione per sempre 2.0〉은 딥페이크 ‘기술’의 관점에서 보면 그다지 대단하지 않다. 기술적 완성도도 떨어진다. 젊은 무티가 나오는 장면을 정지시켜 보면 얼굴과 몸이 완벽하게 맞지 않아 얼굴만 둥둥 떠 있는 것처럼 보인다. 유튜브에 검색만 해도 볼 수 있는 많은 아마추어 딥페이크 영상보다도 어설프다. 현란한 배경과 각종 효과, 화면 전환이 없었다면 이런 결점이 너무나 뚜렷하게 보였을 것이다. 하지만 미디어 기술 및 미디어아트 연구자인 시젝(Cizek), 우리치오(Uricchio), 올로진(Wolozin)에 따르면, 이 작품은 딥페이크 기술을 예술에 활용한 첫 번째 사례라는 데 의미가 있다.[3] ‘과거(1970~1980년대의 무티)와 현재(Z세대 풍의 무티)의 충돌’이라는, 딥페이크가 사람들에게 줄 수 있는 예술적 영감의 가치가 합성 자체의 낮은 수준을 뛰어넘고 있는 것이다.

이 작품은 ‘인간과 인공지능의 공동 창작(co-create)’이라는 관점에서도 우리에게 생각할 거리를 제공한다. 딥페이크와 같은 인공지능을 콘텐츠의 창작에 활용했을 때, 기계의 창조성을 인정할 수 있는지의 문제 말이다. 17세기 계몽사상의 토대를 닦은 르네 데카르트(René Descartes)는 이에 대해 ‘절대 아니’라고 답했을 것이다. 오직 인간만이 이성적 사고를 통해 의식적인 행위를 할 수 있으며, 인간이 아닌 동물은 본능만을 따르는 자동 장치와 같다고 보았기 때문이다. 동물이 이럴진대 기계는 말할 것도 없다. 하지만 데카르트 이후 수백 년간 천천히, 특히 AI가 개발되기 시작한 20세기 후반부터[4]는 상대적으로 빠른 속도로 이에 반하는 견해가 형성되기 시작했다. 동물이나 기계를 동일한 입력값에 언제나 동일한 출력값을 제공하는 도구로 사용하지 않는다면, 어느 정도 그 창의성을 인정해 줄 수 있다는 것이다. 심지어 최초의 프로그래머인 에이다 러브레이스(Ada Lovelace)는 1840년대에 이미 “엔진(기계)는 어느 정도의 복잡성이나 범위를 가진 정교하고 과학적인 음악을 작곡할 수 있다”고 말한 바 있다.[5]

사실 시젝 등이 딥페이크를 주목한 것은 인간과 비非인간 사이의 공동 창작이 가능한가를 연구하기 위해서였다. 하지만 유감스럽게도 첫 번째 딥페이크 아티스트 조셉 아이얼은 데카르트의 견해를 따르고 있다. 그는 시젝 등과의 인터뷰에서 딥페이크가 “단순한 도구”였을 뿐이며, AI는 “무엇인가를 만들어 낼 수는 있지만, 창조적이지는 않다(Create, but It is not creative)”고 평가했다.[6]

되살아난 인물, 비즈니스가 되다

2018년 프랑스 출신 비디오 아티스트 조셉 아이얼(Joseph Ayerle)은 〈Un’emozione per sempre 2.0〉[1]이라는 4분 30초 남짓 길이의 영상을 발표했다. 1980년대 관능미로 주목받았던 이탈리아 여배우 오르넬나 무티(Ornella Mutti)가 주인공이다. 작품의 전반 2분가량은 그녀의 매력이 잘 드러나는 1970~1980년대 출연작의 장면들이 편집돼 흐른다. 이어 잠시 지직거리는 화면과 1인칭 시점에서 지하철 터널을 빠르게 달리는 장면이 지나가더니 이내 현재의 화려한 거리 모습과 함께 오르넬나 무티의 이미지가 다시 나타난다. 무티는 오늘날 뉴욕이나 파리의 패션쇼에서 볼 법한 화려하면서도 세련된 옷을 입고 있지만, 그녀의 얼굴이나 몸에서 세월의 흔적은 전혀 느낄 수 없다. 영상은 다시 30여 년 전 출연작 속 그녀의 모습과 아이폰, 패션잡지 《보그(Vogue)》 등 현재의 물건과 매치된 21세기 무티의 모습을 교차해 보여준 후 마무리된다. 동영상의 제목인 ‘Un’emozione per sempre’은 ‘영원한 감동’이라는 뜻이다.

조셉 아이얼은 이 작품을 만들기 위해 딥페이크 기술을 적용했다. 영상 후반에 나오는 젊은 오르넬나 무티의 모습은 그녀의 얼굴과 현세대 미국의 인기 모델이자 인스타그램 스타인 켄달 제너(Kendall Jenner)의 몸을 각각 학습해 합성한 것이다. 영상 제작을 위해 사용된 사진은 2000장 정도며, 기계학습을 위한 라이브러리로는 구글의 텐서플로우를 활용했다.

작품 설명은 이렇다.

그녀는 돌아올 것입니다. 만약 우리가 시간 여행을 할 수 있다면 어떻게 될까요? 젊고 아름다운 이탈리아 여배우(오르넬라 무티)는 … (중략) … 이 선택지를 얻게 됩니다. 그렇게 섹시한 이탈리아 영화배우는 2018년으로 시간 여행을 떠납니다. 이 영화는 1980년대 분위기와 Z세대 스타일의 충돌이며 우리 자신에 대해 이야기합니다. 자가 학습 인공신경망(AI)을 사용한 덕분에 이번 시간 여행은 할리우드 영화 규모의 예산을 들이지 않고 실현됐습니다. AI는 오르넬라 무티의 얼굴을 계산해 인스타그램 스타 켄달 제너의 몸에 합성(mapping)했습니다.[2]

사실 오르넬라 무티의 얼굴과 제너의 몸이 합성된 장면이 작품 전체에서 차지하는 비중이 10퍼센트도 안 되기 때문에 〈Un’emozione per sempre 2.0〉은 딥페이크 ‘기술’의 관점에서 보면 그다지 대단하지 않다. 기술적 완성도도 떨어진다. 젊은 무티가 나오는 장면을 정지시켜 보면 얼굴과 몸이 완벽하게 맞지 않아 얼굴만 둥둥 떠 있는 것처럼 보인다. 유튜브에 검색만 해도 볼 수 있는 많은 아마추어 딥페이크 영상보다도 어설프다. 현란한 배경과 각종 효과, 화면 전환이 없었다면 이런 결점이 너무나 뚜렷하게 보였을 것이다. 하지만 미디어 기술 및 미디어아트 연구자인 시젝(Cizek), 우리치오(Uricchio), 올로진(Wolozin)에 따르면, 이 작품은 딥페이크 기술을 예술에 활용한 첫 번째 사례라는 데 의미가 있다.[3] ‘과거(1970~1980년대의 무티)와 현재(Z세대 풍의 무티)의 충돌’이라는, 딥페이크가 사람들에게 줄 수 있는 예술적 영감의 가치가 합성 자체의 낮은 수준을 뛰어넘고 있는 것이다.

이 작품은 ‘인간과 인공지능의 공동 창작(co-create)’이라는 관점에서도 우리에게 생각할 거리를 제공한다. 딥페이크와 같은 인공지능을 콘텐츠의 창작에 활용했을 때, 기계의 창조성을 인정할 수 있는지의 문제 말이다. 17세기 계몽사상의 토대를 닦은 르네 데카르트(René Descartes)는 이에 대해 ‘절대 아니’라고 답했을 것이다. 오직 인간만이 이성적 사고를 통해 의식적인 행위를 할 수 있으며, 인간이 아닌 동물은 본능만을 따르는 자동 장치와 같다고 보았기 때문이다. 동물이 이럴진대 기계는 말할 것도 없다. 하지만 데카르트 이후 수백 년간 천천히, 특히 AI가 개발되기 시작한 20세기 후반부터[4]는 상대적으로 빠른 속도로 이에 반하는 견해가 형성되기 시작했다. 동물이나 기계를 동일한 입력값에 언제나 동일한 출력값을 제공하는 도구로 사용하지 않는다면, 어느 정도 그 창의성을 인정해 줄 수 있다는 것이다. 심지어 최초의 프로그래머인 에이다 러브레이스(Ada Lovelace)는 1840년대에 이미 “엔진(기계)는 어느 정도의 복잡성이나 범위를 가진 정교하고 과학적인 음악을 작곡할 수 있다”고 말한 바 있다.[5]

사실 시젝 등이 딥페이크를 주목한 것은 인간과 비非인간 사이의 공동 창작이 가능한가를 연구하기 위해서였다. 하지만 유감스럽게도 첫 번째 딥페이크 아티스트 조셉 아이얼은 데카르트의 견해를 따르고 있다. 그는 시젝 등과의 인터뷰에서 딥페이크가 “단순한 도구”였을 뿐이며, AI는 “무엇인가를 만들어 낼 수는 있지만, 창조적이지는 않다(Create, but It is not creative)”고 평가했다.[6]

하지만 아이얼이 첫 번째 딥페이크 예술 작품을 내놓은 지 단 5년이 지난 지금, 그의 AI에 대한 평가에 대한 의구심이 계속 커지고 있다. 두 얼굴을 바꿔치기하거나 A의 얼굴을 B의 몸에 붙이는 딥페이크 기술이 글로 명령만 하면 그에 해당하는 글이나 그림, 영상 등을 자동으로 만들어주는 ‘생성 AI(Generative AI)’ 기술로 발전하고 있기 때문이다. ‘StyleGAN’이라는 생성 AI 기술을 이용한 웹사이트 ‘This Person Does Not Exist’[7]가 한 사례다, 이 사이트는 접속하거나 웹브라우저의 새로고침 버튼을 누를 때마다 새로운 얼굴 사진을 보여준다. 놀라운 점은 나타나는 얼굴이 모두 임의로 생성한, 현실에는 존재하지 않는 얼굴이라는 점이다. 전문가가 아니고서는 이 얼굴들이 기계로 합성됐다는 것을 알아채기가 지극히 어렵다.

이미 생성 AI가 초래하는 지각변동이 시작된 상태다. 특히 미술계가 그렇다. 2021년 6월 미술계의 미국의 유명 잡지 《코스모폴리탄》과 영국 경제지 《이코노미스트》는 생성 AI가 만들어 낸 그림을 표지로 채택했다. 같은 해 8월에는 생성 AI로 제작한 웹툰 〈염소들 Goats〉이 북미 네이버 웹툰 플랫폼에서 연재를 시작했고 미국 콜로라도주에서 열린 미술 대회에선 AI로 그린 출품작이 사람이 인간을 제치고 디지털 아트 부문 1위를 수상하는 일도 있었다. ‘창작은 인간의 전유물’이라는 개념 자체가 흔들리고 있다.

‘달리2(DALL·E2)’나 ‘미드저니(Midjourney)’와 같은 이미지 전용 생성 AI 플랫폼의 인기도 폭발적이다. 2022년 서비스를 시작한 달리2에서는 벌써 매일 200만 개 이상의 이미지가 생성되고 있고, 미드저니의 공식 디스코드(Discord) 서버에 등록한 회원 수는 300만 명을 돌파했다.[8] 이미지뿐만이 아니다. ‘메타(Meta)’는 지난 2022년 9월 텍스트만 입력하면 그 내용을 반영한 동영상을 만드는 ‘메이크 어 비디오(Make-A-Video)’ 기술을 공개했다. 구글도 이에 질세라 ‘이매진 비디오(Imagine Video)’라는 이름의 동영상 전용 생성 AI를 개발 중이라고 밝혔다. 이 외에도 간단한 모티프만 입력하면 이와 관련된 산문을 출력해 주는 ‘노벨 AI(Novel AI)’, 홀로 AI(Holo AI)’ 등과 같은 텍스트 생성 AI, 구글의 ‘마젠타(Magenta)’와 같은 작곡 및 음악 생성 AI도 활발히 개발되며 사용자층을 넓혀 가고 있다.

‘달리2(DALL·E2)’나 ‘미드저니(Midjourney)’와 같은 이미지 전용 생성 AI 플랫폼의 인기도 폭발적이다. 2022년 서비스를 시작한 달리2에서는 벌써 매일 200만 개 이상의 이미지가 생성되고 있고, 미드저니의 공식 디스코드(Discord) 서버에 등록한 회원 수는 300만 명을 돌파했다.[8] 이미지뿐만이 아니다. ‘메타(Meta)’는 지난 2022년 9월 텍스트만 입력하면 그 내용을 반영한 동영상을 만드는 ‘메이크 어 비디오(Make-A-Video)’ 기술을 공개했다. 구글도 이에 질세라 ‘이매진 비디오(Imagine Video)’라는 이름의 동영상 전용 생성 AI를 개발 중이라고 밝혔다. 이 외에도 간단한 모티프만 입력하면 이와 관련된 산문을 출력해 주는 ‘노벨 AI(Novel AI)’, 홀로 AI(Holo AI)’ 등과 같은 텍스트 생성 AI, 구글의 ‘마젠타(Magenta)’와 같은 작곡 및 음악 생성 AI도 활발히 개발되며 사용자층을 넓혀 가고 있다.

이런 상황에서도 우리는 AI를 과연 조셉 아이얼과 같이 ‘도구’에 불과하다고 단정할 수 있을까? 만일 그렇지 않다면, 즉 기계가 무엇인가 새로운 것을 만들어 낼 수 있다면 그 창의성은 어디에 기인한 것인가? 데이터 학습 알고리즘을 개발한 엔지니어에게서 유래한 것인가, 아니면 학습할 데이터를 제공한 수많은 사람들로부터 만들어진 것인가. 그것도 아니라면 예술가(AI 이용자)와 AI의 관계에서 창의성이 발생하는 것인가? 이는 딥페이크뿐만 아니라 모든 AI를 이용한 작업과 관련해 점점 더 강하게 제기되는 의문들이다.

어쨌든 영상 속 누군가의 얼굴을 다른 사람으로 바꿀 수 있는 딥페이크 기술은 엔터테인먼트 업계의 큰 관심을 받고 있다. 이미 고인이 된 배우의 새로운 연기 장면을 연출하거나, 이제는 노인이 된 인물의 젊은 시절 모습을 영상 속에서 되살릴 수 있는 기술에 호감을 보이지 않는 사람이 업계에 있을 리 없다.

영상 엔터테인먼트 업계에서 딥페이크를 활용한 대표적인 사례는 2021년 러시아의 통신회사 ‘메가폰(Megafon)’의 광고 영상[9]이다. 턱시도를 차려입은 왕년의 할리우드 액션 스타 브루스 윌리스(Bruce Wilis)가 요트에 실린 폭탄 더미에 묶여 있다가 강한 러시아 억양으로 내뱉은 “미시시피”라는 말로 폭탄의 카운트다운을 멈추는, 그의 전형적인 이미지를 이용한 평범하기 그지없는 광고였다. 하지만 이내 이 광고는 전 세계 영화계의 상당한 관심을 끌었다. 브루스 윌리스가 비록 머리카락이 하나도 없는 건 동일하지만, 지금보다 열 살은 젊은 모습으로 등장했을 뿐만 아니라 이미 건강 문제로 그가 제대로 된 연기 생활을 지속할 수 없는 상태라는 이야기가 돌던 상황이었기 때문이다.

많은 사람들이 짐작했던 대로 이 광고에는 딥페이크 기술이 사용됐다. 영상 제작은 러시아 딥페이크 전문 제작사 ‘딥케이크(Deepcake)’가 맡았다. 딥케이크는 그와 비슷한 외형의 러시아 배우에게 연기를 하게 한 다음 그의 얼굴에 브루스 윌리스가 출연했던, 약 200여 편의 영상을 통해 학습한 얼굴을 덧씌웠다고 설명했다. 딥케이크의 CEO 마리아 샤미르(Maria Chmir)에 따르면, 처음 인공신경망에 브루스 윌리스의 얼굴 특징을 학습시키는 데 15~17일 정도 걸리는데, 이후에는 작업 속도가 증가하기 때문에 3~5일이면 4K 화질의 영상을 제작할 수 있다고 한다.

어쨌든 영상 속 누군가의 얼굴을 다른 사람으로 바꿀 수 있는 딥페이크 기술은 엔터테인먼트 업계의 큰 관심을 받고 있다. 이미 고인이 된 배우의 새로운 연기 장면을 연출하거나, 이제는 노인이 된 인물의 젊은 시절 모습을 영상 속에서 되살릴 수 있는 기술에 호감을 보이지 않는 사람이 업계에 있을 리 없다.

영상 엔터테인먼트 업계에서 딥페이크를 활용한 대표적인 사례는 2021년 러시아의 통신회사 ‘메가폰(Megafon)’의 광고 영상[9]이다. 턱시도를 차려입은 왕년의 할리우드 액션 스타 브루스 윌리스(Bruce Wilis)가 요트에 실린 폭탄 더미에 묶여 있다가 강한 러시아 억양으로 내뱉은 “미시시피”라는 말로 폭탄의 카운트다운을 멈추는, 그의 전형적인 이미지를 이용한 평범하기 그지없는 광고였다. 하지만 이내 이 광고는 전 세계 영화계의 상당한 관심을 끌었다. 브루스 윌리스가 비록 머리카락이 하나도 없는 건 동일하지만, 지금보다 열 살은 젊은 모습으로 등장했을 뿐만 아니라 이미 건강 문제로 그가 제대로 된 연기 생활을 지속할 수 없는 상태라는 이야기가 돌던 상황이었기 때문이다.

많은 사람들이 짐작했던 대로 이 광고에는 딥페이크 기술이 사용됐다. 영상 제작은 러시아 딥페이크 전문 제작사 ‘딥케이크(Deepcake)’가 맡았다. 딥케이크는 그와 비슷한 외형의 러시아 배우에게 연기를 하게 한 다음 그의 얼굴에 브루스 윌리스가 출연했던, 약 200여 편의 영상을 통해 학습한 얼굴을 덧씌웠다고 설명했다. 딥케이크의 CEO 마리아 샤미르(Maria Chmir)에 따르면, 처음 인공신경망에 브루스 윌리스의 얼굴 특징을 학습시키는 데 15~17일 정도 걸리는데, 이후에는 작업 속도가 증가하기 때문에 3~5일이면 4K 화질의 영상을 제작할 수 있다고 한다.

2016년에 개봉했던 영화 〈로그 원: 스타워즈 스토리(Rogue One: A Star Wars Story)〉도 딥페이크와 유사한 기술을 사용한 사례다. 이 영화는 1977년에 나온 〈스타워즈 에피소드 4: 새로운 희망(Star Wars Episode Ⅳ: A New Hope)〉의 프리퀄(prequel)인만큼 두 명의 같은 캐릭터가 출연한다. 문제는 설정상 프리퀄 영화의 스토리와 40년 전의 영화의 스토리가 시차 없이 바로 이어진다는 데 있었다. 두 배우 중 시리즈 전체의 주인공을 연기한 캐리 피셔(Carrie Fisher)는 너무 나이가 들어 영화를 찍을 수가 없었고, 다른 주요 조연인 피터 쿠싱(Peter Wilton Cushing)은 이미 1994년에 사망한 상태였다. 결국 제작사는 두 배우의 캐릭터 모두를 대역 배우가 촬영하도록 하고, 과거 배우들의 영상에서 데이터를 추출해 모델링한 컴퓨터 그래픽으로 얼굴을 바꿔치기했다. 덕분에 프리퀄 영화의 관객들은 40년 전의 향수를 만끽할 수 있었다. 딥페이크와 조금은 다른 기술을 사용했던 이유는 시기 때문이었다. ‘딥페이크’라는 이름이 붙은 기술 자체는 2017년 즈음부터 활용되기 시작했는데, 영화 제작이 결정되고 촬영된 시점은 그보다 훨씬 이전이기 때문이다. 그럼에도 불구하고 이 영화에서 사용한 기술이 딥페이크와 유사하다는 점은 틀림이 없다.

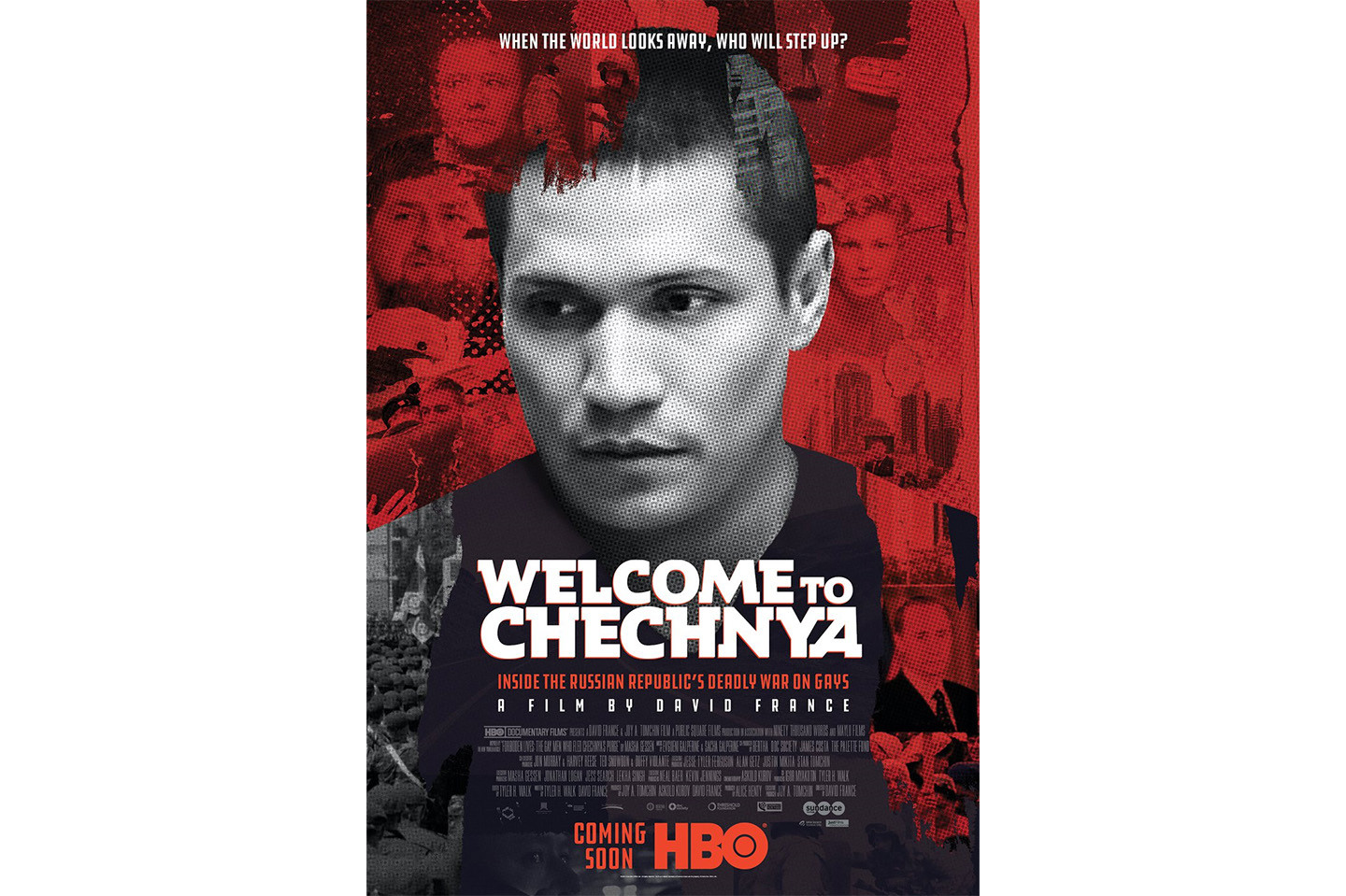

앞선 사례들이 이런저런 이유로 대역 배우의 몸에 덧씌워진 얼굴을 강조하기 위해 딥페이크 기술을 사용했다면, 2020년에 발표된 미국 다큐멘터리 영화 〈웰컴 투 체첸(Welcome to Chechnya)〉은 완전히 반대의 목적으로 딥페이크를 사용했다. 2010년대 후반, 러시아 연방의 이슬람 국가 체첸공화국에서 는 대대적인 동성애자 단속을 벌어 100여 명이 감금, 고문당하고 이 중 일부는 사망하는 사건이 발생했다. 이런 위험천만한 상황에서 체첸의 동성애자들은 외국으로 망명을 시도하는데, 〈웰컴 투 체첸〉은 당시 목숨을 걸고 체첸을 빠져나가려는 동성애자들과 그들의 탈출을 돕는 러시아 LGBT 활동가들의 모습을 담았다. 이 다큐멘터리에는 23명의 동성애자와 활동가들이 인터뷰 대상으로 등장하는데, 감독은 이들의 신변 보호를 위해 딥페이크 기술로 얼굴을 의도적으로 흐리게 처리하거나 조금씩 다른 모습으로 바꿨다. 본래의 얼굴을 지우는 목적이 강조된 것이다.

사실 다큐멘터리 영화에서 딥페이크 기술을 사용할 수 있는지는 지극히 논쟁적인 사안이다. 최대한 객관적으로 사실을 기록함으로써 특정한 주제 의식을 드러내는 것이 다큐멘터리라는 장르의 정체성이기 때문이다. 따라서, 다큐멘터리 제작 과정에서 영상에 인위적인 조작을 가하는 것은 작품 전체의 진실성, 신뢰성의 기반을 스스로 무너뜨리는 일일 수 있다. 더구나 인터뷰이의 얼굴을 가려 누구인지 알 수 없도록 하는 것은 다큐멘터리 감독이 전혀 없는 사실을 만들어 낼 수 있는 수단이 될 수도 있다. 실제로 1990년대 영국의 ITV가 국제 마약 밀매 루트를 추적하는 방송을 촬영하며 대역을 고용해 마약왕을 인터뷰한 것처럼 조작한 사례가 있었다. 물론 인터뷰이의 신원을 보호하기 위해 얼굴을 보이지 않게 하거나, 편집 과정에서 모자이크, 또는 형태 정도만 확인할 수 있도록 블러(blur) 처리하는 것은 흔하게 사용되는 방법이다. 하지만 특정한 목적을 위해 얼굴을 가렸다는 걸 확실하게 드러내는 기법과, 의식적인 노력을 기울이지 않으면 바뀐 얼굴인지 아닌지 알기 힘들도록 딥페이크 기술을 적용하는 것은 완전히 다른 문제다.

앞선 사례들이 이런저런 이유로 대역 배우의 몸에 덧씌워진 얼굴을 강조하기 위해 딥페이크 기술을 사용했다면, 2020년에 발표된 미국 다큐멘터리 영화 〈웰컴 투 체첸(Welcome to Chechnya)〉은 완전히 반대의 목적으로 딥페이크를 사용했다. 2010년대 후반, 러시아 연방의 이슬람 국가 체첸공화국에서 는 대대적인 동성애자 단속을 벌어 100여 명이 감금, 고문당하고 이 중 일부는 사망하는 사건이 발생했다. 이런 위험천만한 상황에서 체첸의 동성애자들은 외국으로 망명을 시도하는데, 〈웰컴 투 체첸〉은 당시 목숨을 걸고 체첸을 빠져나가려는 동성애자들과 그들의 탈출을 돕는 러시아 LGBT 활동가들의 모습을 담았다. 이 다큐멘터리에는 23명의 동성애자와 활동가들이 인터뷰 대상으로 등장하는데, 감독은 이들의 신변 보호를 위해 딥페이크 기술로 얼굴을 의도적으로 흐리게 처리하거나 조금씩 다른 모습으로 바꿨다. 본래의 얼굴을 지우는 목적이 강조된 것이다.

사실 다큐멘터리 영화에서 딥페이크 기술을 사용할 수 있는지는 지극히 논쟁적인 사안이다. 최대한 객관적으로 사실을 기록함으로써 특정한 주제 의식을 드러내는 것이 다큐멘터리라는 장르의 정체성이기 때문이다. 따라서, 다큐멘터리 제작 과정에서 영상에 인위적인 조작을 가하는 것은 작품 전체의 진실성, 신뢰성의 기반을 스스로 무너뜨리는 일일 수 있다. 더구나 인터뷰이의 얼굴을 가려 누구인지 알 수 없도록 하는 것은 다큐멘터리 감독이 전혀 없는 사실을 만들어 낼 수 있는 수단이 될 수도 있다. 실제로 1990년대 영국의 ITV가 국제 마약 밀매 루트를 추적하는 방송을 촬영하며 대역을 고용해 마약왕을 인터뷰한 것처럼 조작한 사례가 있었다. 물론 인터뷰이의 신원을 보호하기 위해 얼굴을 보이지 않게 하거나, 편집 과정에서 모자이크, 또는 형태 정도만 확인할 수 있도록 블러(blur) 처리하는 것은 흔하게 사용되는 방법이다. 하지만 특정한 목적을 위해 얼굴을 가렸다는 걸 확실하게 드러내는 기법과, 의식적인 노력을 기울이지 않으면 바뀐 얼굴인지 아닌지 알기 힘들도록 딥페이크 기술을 적용하는 것은 완전히 다른 문제다.

하지만, 〈웰컴 투 체첸〉의 감독 데이비드 프랑스(David France)는 딥페이크 기술을 사용하는 것이 다른 기법을 사용하는 것보다 훨씬 낫다고 본다. 그는 이 방식으로 “인터뷰 대상자들이 자신의 이야기를 설명할 수 있고, 다른 상황에서는 불가능했을 방식으로 그들의 인간성을 회복시켜 준다”고 말한다.[10] 얼굴과 드러나는 표정을 통해 생각과 감정을 더 잘 전달할 수 있다는 말이다. 그리고 다큐멘터리의 진실성과 관련된 문제에 대해서는 다음과 같은 의견을 밝혔다. “(딥페이크와 같은 기법이) 덜 정직하거나 윤리적이라고 말한다면, 다른 모든 다큐멘터리 제작도 마찬가지다, 이는 제작 과정에 대한 신뢰의 문제다.” 미국 샌프란시스코주립대학교(San Francisco State University) 명예교수이자 다큐멘터리 분야 선구자인 빌 니콜스(Bill Nichols)도 《뉴욕타임스》와의 인터뷰에서 〈웰컴 투 체첸〉에서는 “얼굴을 통해 영혼이 드러나는 것을 볼 수 있다”며 딥페이크가 복잡한 정서적 애착을 허용하면서도 인터뷰 대상자의 정체성을 숨기는 새로운 ‘부드러운 가면(soft mask)’이 될 수 있다고 말했다.[11]

이처럼 딥페이크가 영상 제작 과정에 매우 다양한 목적으로 활용될 수 있다 보니, 이에 대한 업계의 관심도 지속적으로 높아지는 상태다. 이를 잘 보여 주는 것이 앞서 언급했던 브루스 윌리스의 메가폰 광고와 관련된 해프닝이다. 그는 2022년 3월에 실어증과 대본을 제대로 외울 수 없을 정도의 인지 문제로 은퇴한다고 발표했는데, 약 6개월 후 영국 언론 《데일리메일(Daily Mail)》, 《텔레그래프(The Telegragh)》 등에 윌리스가 딥케이크에 그의 얼굴 데이터에 대한 이용 권리를 판매했다는 뉴스가 실렸다. 보도대로라면 딥페이크 기술을 바탕으로 건강 상태와는 상관없이 계속 연기 활동을 하는 초특급 액션 배우가 등장한 것이니 할리우드 영화계는 순식간에 달아올랐다. 하지만 윌리스의 대변인은 곧장 “브루스 윌리스는 초상권이나 얼굴 데이터와 관련해 딥케이크와 어떤 합의도 한 적이 없다”고 밝혔다. 딥케이크 역시 “메가폰 광고 제작 당시 딥케이크는 메가폰과 브루스 윌리스 간의 계약에 대한 제3자로서 얼굴 데이터 제작만 담당했을 뿐, 그의 얼굴 데이터 계약과 관련해 아는 바가 없다”고 발표하면서,[12] 잠깐이나마 딥페이크 커뮤니티와 영화업계를 떠들썩하게 만들었던 사건은 마무리됐다.

브루스 윌리스의 사례는 비록 뜬소문이었지만 많은 영상 엔터테인먼트 기업들이 딥페이크 기술이나 인력을 보강했다는 ‘진짜’ 소식이 심심치 않게 들려온다. 예를 들어 디즈니는 산하 스튜디오(Disney Research Studio)를 통해 직접 딥페이크 기술을 지속적으로 개발·개선하고 있다.[13] 루카스필름의 특수효과 전문 기업 ILM은 뒤에서 언급할, 수준급의 딥페이크 영상을 전문적으로 업로드하던 유튜버 ‘샴묵(Shamook)’을 직접 고용하기도 했다.

이쯤에서 궁금한 점이 생긴다. 유명 배우의 얼굴 데이터만 사용할 수 있다면 배우의 나이에도, 건강에도, 구애받을 필요가 없다. 그렇다면 모든 영상을 딥페이크로 대체하는 게 낫지 않을까? 제작사 입장에서는 직접 배우를 기용하지 않아도 되기에 출연료를 훨씬 줄일 수 있다. 또한 관객들이 원하는 배우의 나이대를 선택해 출연시킬 수도 있고, 심지어는 죽은 배우도 언제든지 스크린에 불러올 수 있다. 배우의 입장에서도 촬영에 따르는 이런저런 불편함과 위험을 겪을 필요가 없거니와, 직접 출연할 때보다 더 많은 작품에 출연할 수 있게 된다. 부족한 능력을 대역이 보완해 줄 수도 있을 것이다. 이렇게 장점이 많은데 대체 왜 딥페이크 기술이 모든 영상을 장악하지 못하는 것일까?

첫 번째 이유는 딥페이크 기술의 효율성이 그렇게까지 높지 않기 때문이다. 디지털 영상을 제작하는 과정에는 영상에 대한 데이터를 우리가 실제로 볼 수 있는 영상으로 만들어 내는 렌더링(rendering) 작업이 필요한데, 이 렌더링 작업에 어마어마한 컴퓨팅 파워와 시간이 소요된다. 일례로 1993년에 공개된 영화 〈쥬라기 공원 〉의 경우 공룡의 3D 모델을 렌더링하는 작업에 하나의 프레임당 네 시간 이상이 걸렸고, 특히 비를 맞고 있는 티라노사우르스의 장면은 한 프레임을 렌더링하는데 여섯 시간이 소요됐다.[14] 영화는 초당 24프레임으로 제작되는데, 영화나 드라마, 시리즈물 같은 장편 영상을 모두 대역을 통해 촬영하고, 대역의 얼굴을 프레임별로 일일이 딥페이크로 수정한 다음에 이 영상을 다시 몽땅 렌더링하는 것이 과연 처음부터 비싼 돈을 주고 유명 배우가 직접 촬영하도록 하는 것보다 나은 일일까?

두 번째 이유는 딥페이크를 통해 고화질 영상을 제작하기에 (최소한 현재는) 어느 정도 기술적 한계가 있기 때문이다. 딥페이크 기술은 개발 과정에서 화질을 높이는 것보다 얼굴 특징을 자연스럽게 바꾸는 것에 초점을 맞추는 경향이 높았기 때문에 최종적으로 산출된 영상의 화질이 원본보다 열화되는 경우가 많다. 애초부터 고화질 TV나 영화관 같은 대형 스크린을 상정하고 개발된 기술이 아니라는 뜻이다. 2020년 디즈니 리서치 스튜디오가 처음으로 1024x1024의 메가픽셀 해상도로 딥페이크 영상을 제작할 수 있는 기술을 개발했지만, 최근 4K 가정용 TV와 모니터가 보편화하고 있고, 8K 영화도 등장하고 있다는 것을 생각하면 아직 FHD(1920x1080) 해상도도 지원하기 버거워하는 딥페이크 기술을 영상 업계가 전면적으로 적용할 수는 없는 노릇이다.

마지막 이유는 가상 배우(Virtual Actor) 기술의 발전이다. 대역조차 없이 처음부터 배역에 맞는 완벽한 외모를 갖고 감독의 의도와 한 치의 오차도 없이 움직이는 배우를 만들어 기용하는 기술이 이미 상당히 개발돼 있다. 최근 인기가 높은 슈퍼 히어로 영화들에서 우리가 보는 인물들, 캐릭터의 상당수는 인간 배우에 전혀 기대지 않은 데이터들이다. 실제 사람처럼 움직이고 말하는 캐릭터를 처음부터 만들 수 있는데 굳이 얼굴을 바꾸는 작업을 해야 할까?

이러한 한계 때문에 딥페이크 기술의 활용은 아마추어 영상 제작자들이 활동하는 커뮤니티에서 훨씬 더 활성화돼 있다. 딥페이크를 이용해 영상 속의 얼굴을 바꿔치기하는 건 이미 유튜브와 같은 동영상 플랫폼에서는 잘 알려진 ‘놀이’로 자리 잡았다. 사실, 딥페이크 기반의 포르노 영상들만큼 이 기술을 대중에게 알리는 데 혁혁한 공을 세운 것이 바로 서로 관련은 있지만 완전히 다른 유명인의 얼굴을 서로 바꿔치기한 딥페이크 영상들이다. 영화 〈람보 (Rambo)〉의 주연인 실베스터 스탤론(Sylvester Stallone)의 얼굴을 그와 여러모로 비견되는 배우 아놀드 슈워제네거(Arnold Schwarzenegger)의 얼굴로 바꾼다든가, 반대로 영화 〈코만도(Commando)〉에 출연한 슈워제네거의 얼굴을 스탤론의 얼굴로 바꾼 것들이 이런 사례에 속한다. 물론 딥페이크 기술이 등장하기 전에도 이와 비슷한 놀이는 있었다. 하지만 2000년대 말 이전까지 이런 놀이는 대부분 스틸 이미지를 기반으로 이뤄졌다. 하지만 딥페이크 기술이 알려지면서 이 놀이의 영역이 동영상으로까지 넓어졌다. 이 놀이에서 ‘사람들이 얼굴이 바뀌었다는 것을 모르게’ 하는 것이나 ‘최대한 자연스럽게 튀지 않도록’ 얼굴을 바꾸는 것은 중요하지 않다. 의외의 몸에 의외의 얼굴을 붙임으로써 어색함, 코믹함을 드러내는 것이 목적이기 때문이다. 영상의 질이 높지 않아도 되기 때문에 이 기술에 흥미를 가진 사람들은 너도나도 이런 종류의 영상을 만들어 유튜브에 업로드했고, 결과물이 트위터, 페이스북 등을 통해 확산하면서 딥페이크 자체의 인지도도 높아졌다.

이처럼 딥페이크가 영상 제작 과정에 매우 다양한 목적으로 활용될 수 있다 보니, 이에 대한 업계의 관심도 지속적으로 높아지는 상태다. 이를 잘 보여 주는 것이 앞서 언급했던 브루스 윌리스의 메가폰 광고와 관련된 해프닝이다. 그는 2022년 3월에 실어증과 대본을 제대로 외울 수 없을 정도의 인지 문제로 은퇴한다고 발표했는데, 약 6개월 후 영국 언론 《데일리메일(Daily Mail)》, 《텔레그래프(The Telegragh)》 등에 윌리스가 딥케이크에 그의 얼굴 데이터에 대한 이용 권리를 판매했다는 뉴스가 실렸다. 보도대로라면 딥페이크 기술을 바탕으로 건강 상태와는 상관없이 계속 연기 활동을 하는 초특급 액션 배우가 등장한 것이니 할리우드 영화계는 순식간에 달아올랐다. 하지만 윌리스의 대변인은 곧장 “브루스 윌리스는 초상권이나 얼굴 데이터와 관련해 딥케이크와 어떤 합의도 한 적이 없다”고 밝혔다. 딥케이크 역시 “메가폰 광고 제작 당시 딥케이크는 메가폰과 브루스 윌리스 간의 계약에 대한 제3자로서 얼굴 데이터 제작만 담당했을 뿐, 그의 얼굴 데이터 계약과 관련해 아는 바가 없다”고 발표하면서,[12] 잠깐이나마 딥페이크 커뮤니티와 영화업계를 떠들썩하게 만들었던 사건은 마무리됐다.

브루스 윌리스의 사례는 비록 뜬소문이었지만 많은 영상 엔터테인먼트 기업들이 딥페이크 기술이나 인력을 보강했다는 ‘진짜’ 소식이 심심치 않게 들려온다. 예를 들어 디즈니는 산하 스튜디오(Disney Research Studio)를 통해 직접 딥페이크 기술을 지속적으로 개발·개선하고 있다.[13] 루카스필름의 특수효과 전문 기업 ILM은 뒤에서 언급할, 수준급의 딥페이크 영상을 전문적으로 업로드하던 유튜버 ‘샴묵(Shamook)’을 직접 고용하기도 했다.

진짜 얼굴 vs. 가상의 얼굴

이쯤에서 궁금한 점이 생긴다. 유명 배우의 얼굴 데이터만 사용할 수 있다면 배우의 나이에도, 건강에도, 구애받을 필요가 없다. 그렇다면 모든 영상을 딥페이크로 대체하는 게 낫지 않을까? 제작사 입장에서는 직접 배우를 기용하지 않아도 되기에 출연료를 훨씬 줄일 수 있다. 또한 관객들이 원하는 배우의 나이대를 선택해 출연시킬 수도 있고, 심지어는 죽은 배우도 언제든지 스크린에 불러올 수 있다. 배우의 입장에서도 촬영에 따르는 이런저런 불편함과 위험을 겪을 필요가 없거니와, 직접 출연할 때보다 더 많은 작품에 출연할 수 있게 된다. 부족한 능력을 대역이 보완해 줄 수도 있을 것이다. 이렇게 장점이 많은데 대체 왜 딥페이크 기술이 모든 영상을 장악하지 못하는 것일까?

첫 번째 이유는 딥페이크 기술의 효율성이 그렇게까지 높지 않기 때문이다. 디지털 영상을 제작하는 과정에는 영상에 대한 데이터를 우리가 실제로 볼 수 있는 영상으로 만들어 내는 렌더링(rendering) 작업이 필요한데, 이 렌더링 작업에 어마어마한 컴퓨팅 파워와 시간이 소요된다. 일례로 1993년에 공개된 영화 〈쥬라기 공원 〉의 경우 공룡의 3D 모델을 렌더링하는 작업에 하나의 프레임당 네 시간 이상이 걸렸고, 특히 비를 맞고 있는 티라노사우르스의 장면은 한 프레임을 렌더링하는데 여섯 시간이 소요됐다.[14] 영화는 초당 24프레임으로 제작되는데, 영화나 드라마, 시리즈물 같은 장편 영상을 모두 대역을 통해 촬영하고, 대역의 얼굴을 프레임별로 일일이 딥페이크로 수정한 다음에 이 영상을 다시 몽땅 렌더링하는 것이 과연 처음부터 비싼 돈을 주고 유명 배우가 직접 촬영하도록 하는 것보다 나은 일일까?

두 번째 이유는 딥페이크를 통해 고화질 영상을 제작하기에 (최소한 현재는) 어느 정도 기술적 한계가 있기 때문이다. 딥페이크 기술은 개발 과정에서 화질을 높이는 것보다 얼굴 특징을 자연스럽게 바꾸는 것에 초점을 맞추는 경향이 높았기 때문에 최종적으로 산출된 영상의 화질이 원본보다 열화되는 경우가 많다. 애초부터 고화질 TV나 영화관 같은 대형 스크린을 상정하고 개발된 기술이 아니라는 뜻이다. 2020년 디즈니 리서치 스튜디오가 처음으로 1024x1024의 메가픽셀 해상도로 딥페이크 영상을 제작할 수 있는 기술을 개발했지만, 최근 4K 가정용 TV와 모니터가 보편화하고 있고, 8K 영화도 등장하고 있다는 것을 생각하면 아직 FHD(1920x1080) 해상도도 지원하기 버거워하는 딥페이크 기술을 영상 업계가 전면적으로 적용할 수는 없는 노릇이다.

마지막 이유는 가상 배우(Virtual Actor) 기술의 발전이다. 대역조차 없이 처음부터 배역에 맞는 완벽한 외모를 갖고 감독의 의도와 한 치의 오차도 없이 움직이는 배우를 만들어 기용하는 기술이 이미 상당히 개발돼 있다. 최근 인기가 높은 슈퍼 히어로 영화들에서 우리가 보는 인물들, 캐릭터의 상당수는 인간 배우에 전혀 기대지 않은 데이터들이다. 실제 사람처럼 움직이고 말하는 캐릭터를 처음부터 만들 수 있는데 굳이 얼굴을 바꾸는 작업을 해야 할까?

이러한 한계 때문에 딥페이크 기술의 활용은 아마추어 영상 제작자들이 활동하는 커뮤니티에서 훨씬 더 활성화돼 있다. 딥페이크를 이용해 영상 속의 얼굴을 바꿔치기하는 건 이미 유튜브와 같은 동영상 플랫폼에서는 잘 알려진 ‘놀이’로 자리 잡았다. 사실, 딥페이크 기반의 포르노 영상들만큼 이 기술을 대중에게 알리는 데 혁혁한 공을 세운 것이 바로 서로 관련은 있지만 완전히 다른 유명인의 얼굴을 서로 바꿔치기한 딥페이크 영상들이다. 영화 〈람보 (Rambo)〉의 주연인 실베스터 스탤론(Sylvester Stallone)의 얼굴을 그와 여러모로 비견되는 배우 아놀드 슈워제네거(Arnold Schwarzenegger)의 얼굴로 바꾼다든가, 반대로 영화 〈코만도(Commando)〉에 출연한 슈워제네거의 얼굴을 스탤론의 얼굴로 바꾼 것들이 이런 사례에 속한다. 물론 딥페이크 기술이 등장하기 전에도 이와 비슷한 놀이는 있었다. 하지만 2000년대 말 이전까지 이런 놀이는 대부분 스틸 이미지를 기반으로 이뤄졌다. 하지만 딥페이크 기술이 알려지면서 이 놀이의 영역이 동영상으로까지 넓어졌다. 이 놀이에서 ‘사람들이 얼굴이 바뀌었다는 것을 모르게’ 하는 것이나 ‘최대한 자연스럽게 튀지 않도록’ 얼굴을 바꾸는 것은 중요하지 않다. 의외의 몸에 의외의 얼굴을 붙임으로써 어색함, 코믹함을 드러내는 것이 목적이기 때문이다. 영상의 질이 높지 않아도 되기 때문에 이 기술에 흥미를 가진 사람들은 너도나도 이런 종류의 영상을 만들어 유튜브에 업로드했고, 결과물이 트위터, 페이스북 등을 통해 확산하면서 딥페이크 자체의 인지도도 높아졌다.

아마추어 딥페이크 영상 제작자들이 늘어나다 보면 좀 더 높은 품질의 작품을 만들어 보고 싶은 사람도 나오는 법이다. 이들은 이내 좋아하는 연예인이나 아이돌이 관련된 팬아트 FanArt로서의 딥페이크 영상을 만들기 시작했다. 2020년에 등장한 〈Robert Downey Jr and Tom Holland in Back to the future〉 영상이 대표적 사례다.[15] 1985년 개봉 영화 〈백 투더 퓨처Back to the Future〉의 두 주인공인 마이클 J 폭스 (Michael J. Fox)와 크리스토퍼 로이드(Christopher Lloyd)가 얼굴을 마주 보며 서로 대화하는 장면을 딥페이크로 수정한 것인데, 제작자는 젊은 폭스의 얼굴에 톰 홀랜드(Tom Holland)의 얼굴을, 로이드의 로버트 다우니 주니어(Robert Downey Jr)의 얼굴을 합성했다. 홀랜드와 다우니가 마블(Marvel) 슈퍼히어로 영화 시리즈에 유사 부자 관계로 나와 큰 인기를 끌었던 것을 반영해 둘의 얼굴을 역시 비슷한 관계를 보이는 〈백 투더 퓨처〉 속 배우의 몸에 붙인 것이다.

2023년 현재 아마추어 커뮤니티, 특히 유튜브를 중심으로 한 딥페이크 영상 제작은 더 이상 아마추어라고 하기 어려운 수준으로 발전했다. 유튜브 이용자들은 일반적인 영화나 드라마보다 훨씬 짧은 길이의 영상을 선호하기 때문에 유튜브 영상 제작자들은 ‘영혼을 갈아 넣은’ 수준의, 짧지만 고품질의 딥페이크 영상을 만든다. 대형 화면에서 유튜브를 시청하는 경우가 적기 때문에 고화질 영상을 제작하기 어렵다는 현재 딥페이크 기술의 단점도 크게 작용하지 않는다.

대표적인 사례가 앞서 디즈니 리서치 스튜디오에 고용됐다고 언급했던 유튜버 ‘샴묵’이다. 샴묵은 주로 사람들이 잘 아는 영화나 드라마를 이용한 딥페이크 영상을 제작해 왔는데, 큰 관심을 모았던 것 중 하나가 〈로그 원: 스타워즈 스토리〉 원본 영화에 합성된 CGI 캐리 피셔의 얼굴을 실제 캐리 피셔의 사진을 이용한 얼굴 데이터로 바꾼 영상이다. CGI 피셔의 얼굴보다 딥페이크 피셔의 얼굴이 훨씬 자연스러웠기 때문에 화제가 됐다. 2018년에 리부트된 영화 〈툼 레이더(Tomb Raider)〉 주인공의 얼굴을 2001년 원 시리즈의 주인공이었던 안젤리나 졸리(Angelina Jolie)의 얼굴로 바꾼 샴묵의 영상도 큰 인기를 끌었다. 이런 영상들은 샴묵이 ILM에 고용되는 발판이 됐다. 기술의 단점이 상대적으로 덜 중요하게 작동하는 아마추어 중심의 온라인 커뮤니티가 앞으로도 상당 기간 딥페이크 영상 제작의 핵심 기반이 될 것으로 보인다.

2023년 현재 아마추어 커뮤니티, 특히 유튜브를 중심으로 한 딥페이크 영상 제작은 더 이상 아마추어라고 하기 어려운 수준으로 발전했다. 유튜브 이용자들은 일반적인 영화나 드라마보다 훨씬 짧은 길이의 영상을 선호하기 때문에 유튜브 영상 제작자들은 ‘영혼을 갈아 넣은’ 수준의, 짧지만 고품질의 딥페이크 영상을 만든다. 대형 화면에서 유튜브를 시청하는 경우가 적기 때문에 고화질 영상을 제작하기 어렵다는 현재 딥페이크 기술의 단점도 크게 작용하지 않는다.

대표적인 사례가 앞서 디즈니 리서치 스튜디오에 고용됐다고 언급했던 유튜버 ‘샴묵’이다. 샴묵은 주로 사람들이 잘 아는 영화나 드라마를 이용한 딥페이크 영상을 제작해 왔는데, 큰 관심을 모았던 것 중 하나가 〈로그 원: 스타워즈 스토리〉 원본 영화에 합성된 CGI 캐리 피셔의 얼굴을 실제 캐리 피셔의 사진을 이용한 얼굴 데이터로 바꾼 영상이다. CGI 피셔의 얼굴보다 딥페이크 피셔의 얼굴이 훨씬 자연스러웠기 때문에 화제가 됐다. 2018년에 리부트된 영화 〈툼 레이더(Tomb Raider)〉 주인공의 얼굴을 2001년 원 시리즈의 주인공이었던 안젤리나 졸리(Angelina Jolie)의 얼굴로 바꾼 샴묵의 영상도 큰 인기를 끌었다. 이런 영상들은 샴묵이 ILM에 고용되는 발판이 됐다. 기술의 단점이 상대적으로 덜 중요하게 작동하는 아마추어 중심의 온라인 커뮤니티가 앞으로도 상당 기간 딥페이크 영상 제작의 핵심 기반이 될 것으로 보인다.

지금까지는 딥페이크 기술을 긍정적, 창의적으로 활용하는 사례 중에서, 진짜 사람의 얼굴을 다른 진짜 사람의 얼굴로 바꾸는 경우를 살펴보았다. 하지만, 이와는 좀 다르게 가상의 얼굴을 만들어 놓고 이를 진짜 얼굴과 바꾸는 경우도 나타나고 있다. 아니, 정확하게 말하자면 최근에는 이러한 종류의 얼굴 바꾸기 기술이 산업계에서 더 활발하게 사용되고 있다.

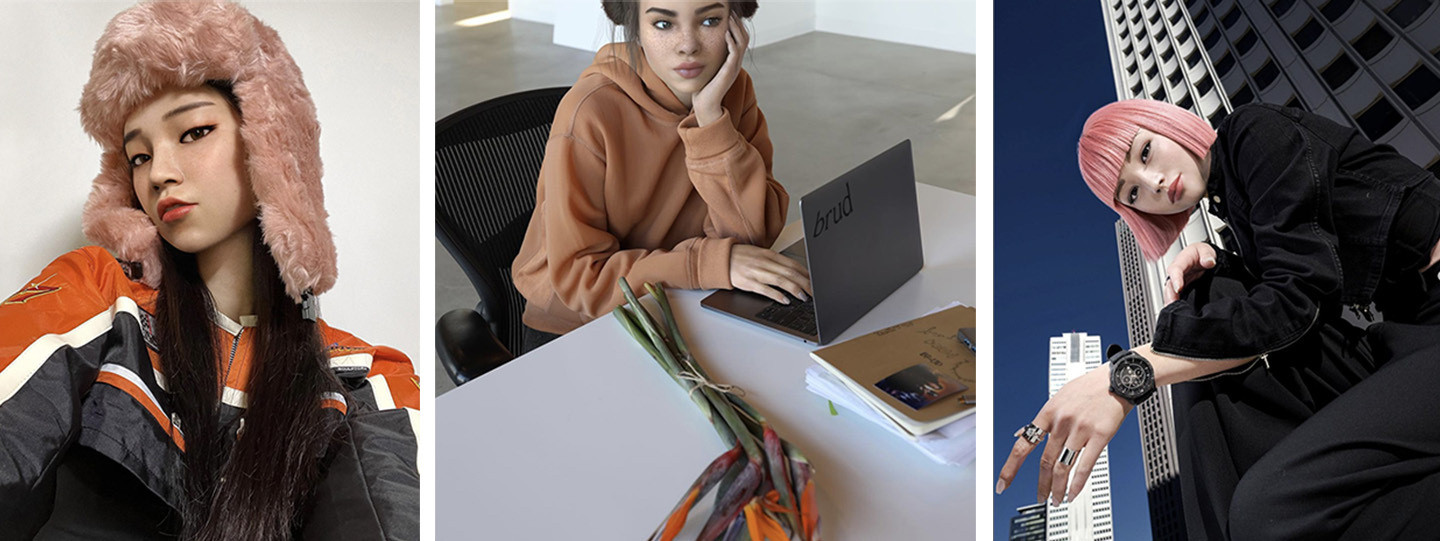

2021년 7월 국내의 한 금융사는 〈라이프에 놀라움을 더하다〉 라는 30초 길이의 영상 광고를 TV와 유튜브 등으로 내보냈다. 키가 크고 한국 사람은 확실한 것 같지만 어딘가 이국적인 얼굴의 젊은 여성이 건물 옥상이나 거대한 온실, 지하철 등에서 흥겨운 음악에 맞춰 춤을 추다 캐치프레이즈와 금융사 로고가 떠오르고 광고 영상은 끝난다. 화면은 화려했지만, 젊은 여성의 이미지를 이용한 흔한 광고였기 때문에 나온 직후에는 사람들의 관심을 끌지 못했다. 하지만, 일주일 후부터 이 광고는 점점 더 사람들의 입소문을 타기 시작했다. 광고 속에서 신나게 춤을 추던 모델 ‘로지(OH!_ROZY)’가 콘텐츠 제작사 싸이더스 스튜디오가 제작한 가상의 인간, 이른바 ‘버추얼 인플루언서(virtual influencer)’임이 밝혀졌기 때문이다.

버추얼 인플루언서는 기업이 마케팅을 목적으로 생성한 캐릭터로, 실제 사람처럼 성별, 나이, 성격 등과 같은 정체성과 관련된 특징이 ‘설정’돼 있다. 예를 들어 로지는 서울에서 태어나 패션과 환경 보호에 관심이 많은, 영원히 22살인 대한민국의 여성으로, 일본의 해적 만화 〈원피스〉를 좋아하고 ‘오씨’라는 이름의 반려 과일을 키운다. 버추얼 인플루언서들은 이러한 설정에 맞게 인스타그램, 페이스북 등에서 다양한 마케팅 활동을 전개한다. 로지 이외에도 이미 전 세계 마케팅 업계에서는 수백 명의 버추얼 인플루언서들이 활동 중이다. 2018년 타임 선정 인터넷에서 가장 영향력 있는 25인에 뽑인 ‘릴 미켈라(Lil Miquela)’, 일본의 패션 슈퍼스타 ‘이마(Imma)’ 등이 대표적이다. 우리나라에서도 로지 이후 스마일게이트가 제작한 ‘한유아’, LG전자의 ‘김래아’ 등 버추얼 인플루언서들이 잇달아 등장했다.

2021년 7월 국내의 한 금융사는 〈라이프에 놀라움을 더하다〉 라는 30초 길이의 영상 광고를 TV와 유튜브 등으로 내보냈다. 키가 크고 한국 사람은 확실한 것 같지만 어딘가 이국적인 얼굴의 젊은 여성이 건물 옥상이나 거대한 온실, 지하철 등에서 흥겨운 음악에 맞춰 춤을 추다 캐치프레이즈와 금융사 로고가 떠오르고 광고 영상은 끝난다. 화면은 화려했지만, 젊은 여성의 이미지를 이용한 흔한 광고였기 때문에 나온 직후에는 사람들의 관심을 끌지 못했다. 하지만, 일주일 후부터 이 광고는 점점 더 사람들의 입소문을 타기 시작했다. 광고 속에서 신나게 춤을 추던 모델 ‘로지(OH!_ROZY)’가 콘텐츠 제작사 싸이더스 스튜디오가 제작한 가상의 인간, 이른바 ‘버추얼 인플루언서(virtual influencer)’임이 밝혀졌기 때문이다.

버추얼 인플루언서는 기업이 마케팅을 목적으로 생성한 캐릭터로, 실제 사람처럼 성별, 나이, 성격 등과 같은 정체성과 관련된 특징이 ‘설정’돼 있다. 예를 들어 로지는 서울에서 태어나 패션과 환경 보호에 관심이 많은, 영원히 22살인 대한민국의 여성으로, 일본의 해적 만화 〈원피스〉를 좋아하고 ‘오씨’라는 이름의 반려 과일을 키운다. 버추얼 인플루언서들은 이러한 설정에 맞게 인스타그램, 페이스북 등에서 다양한 마케팅 활동을 전개한다. 로지 이외에도 이미 전 세계 마케팅 업계에서는 수백 명의 버추얼 인플루언서들이 활동 중이다. 2018년 타임 선정 인터넷에서 가장 영향력 있는 25인에 뽑인 ‘릴 미켈라(Lil Miquela)’, 일본의 패션 슈퍼스타 ‘이마(Imma)’ 등이 대표적이다. 우리나라에서도 로지 이후 스마일게이트가 제작한 ‘한유아’, LG전자의 ‘김래아’ 등 버추얼 인플루언서들이 잇달아 등장했다.

버추얼 인플루언서들의 얼굴은 정교하게 기획되고 제작된 것이다. 일례로 로지의 얼굴은 10대와 20대가 좋아하는 특징을 바탕으로 디자인됐다. 이른바 MZ세대라고 하는, 마케팅의 타깃들이 친숙하게 받아들일 수 있도록 주근깨와 같은 자연스러운 요소들을 적극적으로 포함했다. 제작사는 로지가 개성적이면서도 친근하게 느껴지도록 만들기 위해 6개월가량의 시간을 들여 얼굴 윤곽과 머리카락, 주름 등을 구상했다고 한다. 여기에 더해 로지가 다양한 감정을 표현할 수 있도록 800개 이상의 표정도 만들었다.[16]

하지만 버추얼 인플루언서의 몸은 이와 다르다. 대부분 의 경우 해당 버추얼 인플루언서의 설정과 부합하는 몸을 가진 모델이 먼저 촬영을 하고, 이후 모델의 얼굴을 버추얼 인플루언서의 얼굴로 대체한다. 광고 속에서 춤을 추는 로지의 몸 역시 콘티에 따라 춤을 춘 안무가의 몸이었다. 일본의 패션 버추얼 인플루언서 ‘이마’의 광고 사진 역시 모델의 얼굴을 ‘이마’의 얼굴로 교체한 것이다. 이렇게 하는 이유는 대부분 시간과 비용 때문이다. 버추얼 인플루언서의 몸 전체와 옷가지, 액세서리 등 몸에 걸친 광고의 대상들을 자연스럽게 합성해 내는 건 많은 자원이 드는 일이고, 혹여라도 합성에 실수가 발생했을 경우 광고의 품질에 치명적인 타격을 입을 수도 있다. 이에 비해 ‘얼굴만’ 자연스럽게 교체하는 것은 상대적으로 쉽다. 이것이 바로 버추얼 인플루언서의 특징인 ‘얼굴과 몸의 기묘한 분리’가 나타나는 원인이다.

가상의 얼굴이 묻다

시장조사업체 ‘나스미디어(NASMEDIA)’는 2022년 전 세계 인플루언서 마케팅 시장 규모를 150억 달러로 추산했는데, 이 중 상당 부분을 버추얼 인플루언서가 차지할 것으로 봤다. 이들을 이용한 광고, 마케팅 프로젝트가 늘어나는 이유는 무엇일까?

첫 번째는 ‘안전’이다. 버추얼 인플루언서는 제작사의 완벽한 통제 아래 있다. 음주 운전이나 마약 복용으로 광고주나 제품의 이미지에 먹칠을 하는 일도 없고, 아프거나 다쳐서 광고나 마케팅 프로젝트 일정에 차질을 주는 경우도 없다. 버추얼 인플루언서만큼 그 성실함을 신뢰할 수 있는 모델은 없다. 두 번째는 ‘자유로움’이다. 버추얼 인플루언서는 무(無)에서 창조된 인물이기 때문에 무엇에도 구애받지 않고 자유롭게 내러티브와 특징을 설정할 수 있다. 실제 인간이라면 모든 사람이 좋아하는 특징만 가지는 것은 불가능하다. 하지만 버추얼 인플루언서라면 이론상으론 가능하다. 마지막은 ‘신선함’이다. 버추얼 인플루언서는 존재 자체만으로도 소비자의 흥미를 끈다. 로지가 등장한 광고는 유튜브 공개 이후 20여 일 만에 누적 조회수 1000만 회를 기록했다.

하지만 이는 어디까지나 마케팅 차원의 이야기다. 릴 미켈라나 이마, 로지의 합성된 가상의 얼굴은 우리에게 ‘주체성(subjectivity)’과 ‘정체성(identity)’에 대한 질문을 던진다. 주체성이란 어떤 존재가 자신의 의지로서 어떤 대상에 작용하려는 자세이며, 정체성은 ‘내’가 누구인지에 대한 인식, 즉 스스로에 대한 자각이나 존재에 대한 깨달음을 말한다. 이 둘 중 버추얼 인플루언서에 있는 것은 정체성이다. 제작사들은 버추얼 인플루언서들의 정체성을 형성하는데 큰 공을 들인다. 보는 사람들이 매력을 느낄 수 있게 하기 위해서다. 그리고 거의 모든 버추얼 인플루언서들의 정체성은 ‘주체성이 있는’ 것으로 설정된다. 예를 들어 릴 미켈라의 관심사는 인권과 성 평등이며, 로지는 환경 보호에 관심이 많다. 주체적으로 무엇인가를 할 수 없는 수동적인 캐릭터에 매력을 느끼는 사람은 그렇지 않은 사람들보다 적기 때문이다. 수동적인 광고 모델을 기용해 브랜드에 주체적이지 못하다는 이미지를 덧씌우고 싶은 브랜드가 있을까?

하지만 주체성이 있다고 설정된 버추얼 인플루언서는 사실 주체성을 가질 수 없다. 주체성은 주체가 되려는 노력의 ‘역사’를 통해 확립되는 것이기 때문이다. 하지만 만들어진 가상의 얼굴에는 역사가 있다는 주장만 있을 뿐 실제 시간이 흐르며 형성된, 주체가 형성돼 온 역사가 반영될 수 없다. 사람들은 역사가 있다는 주장을 실제 역사로 받아들일 만큼 어리석지 않다. 이것이 버추얼 인플루언서들이 비록 나름의 인기를 끌고, 마케팅 분야에서 어느 정도 자리를 잡아 가고 있다고 해도 인간 인플루언서, 모델을 완전히 대체할 수 없는 이유다. 사람들은 개인의 역사 속에서 정체성과 주체성을 형성한 개체로서, 다른 사람들도 각자의 역사를 통해 비슷한 과정을 겪었다는 것을 알고 있기 때문이다. 그렇다면, 만들어진 얼굴을 가진, 버추얼 인플루언서는 역사성을 가질 수 있는 방법이 전혀 없는 것일까? 다음의 사례를 보자.

‘코드미코(CodeMiko)’는 이른바 ‘버추얼 스트리머(virtual streamer)’다. 버추얼 스트리머는 본인이 아닌, 움직이는 2D 혹은 3D 캐릭터를 통해 방송을 진행하는 인터넷 방송인을 말한다. 실제 코드미코는 한국에서 태어나 어린 시절 미국으로 이민을 간 한국계 미국 여성이지만 인터넷 방송에서는 젊은 여성 게임 캐릭터의 얼굴과 몸으로 모습을 바꿔 토크 위주의 방송을 진행한다. ‘초대형 비디오 게임에 출연하는 게 꿈인, 비디오 게임 세계에 사는 캐릭터’라는 설정이다. 코드미코는 풀 바디 모션 트래킹(full body motion tracking) 장비를 활용해 상당히 높은 수준으로 얼굴과 몸을 실시간으로 변경한다. 나름의 설정을 만들어 그대로 모습을 바꾼다는 점은 앞서 언급했던 다른 버추얼 인플루언서들과 동일하다. 하지만 다른 버추얼 인플루언서들과 코드미코의 근본적인 차이는 코드미코가 가상의 얼굴이 대체한 본인의 진짜 얼굴을 숨기지 않는다는 점이다. 라이브로 풀 바디 모션트래킹 방송을 할 때면 화장실에도 갈 수 없기 때문에 방송을 할 수 있는 시간이 4~5시간에 불과하다. 이 때문에 코드미코는 모습을 바꾼 방송을 하지 않을 때는 카메라 앞에서 실제 본인의 모습을 드러내고 방송을 진행한다. 현재 현실의 코드미코는 아예 ‘기술자(The Technician)’라는 캐릭터로 모션 트래킹 방송과 관련된 여러 기술적 이슈나 모습을 바꾼 방송을 준비하는 과정을 스트리밍한다. 코드미코의 시청자들은 코드미코가 얼굴이 바뀐 버추얼 스트리머와 실제 모습을 오가는 것에 별다른 위화감이나 불만을 느끼지 않는다.

하지만 버추얼 인플루언서의 몸은 이와 다르다. 대부분 의 경우 해당 버추얼 인플루언서의 설정과 부합하는 몸을 가진 모델이 먼저 촬영을 하고, 이후 모델의 얼굴을 버추얼 인플루언서의 얼굴로 대체한다. 광고 속에서 춤을 추는 로지의 몸 역시 콘티에 따라 춤을 춘 안무가의 몸이었다. 일본의 패션 버추얼 인플루언서 ‘이마’의 광고 사진 역시 모델의 얼굴을 ‘이마’의 얼굴로 교체한 것이다. 이렇게 하는 이유는 대부분 시간과 비용 때문이다. 버추얼 인플루언서의 몸 전체와 옷가지, 액세서리 등 몸에 걸친 광고의 대상들을 자연스럽게 합성해 내는 건 많은 자원이 드는 일이고, 혹여라도 합성에 실수가 발생했을 경우 광고의 품질에 치명적인 타격을 입을 수도 있다. 이에 비해 ‘얼굴만’ 자연스럽게 교체하는 것은 상대적으로 쉽다. 이것이 바로 버추얼 인플루언서의 특징인 ‘얼굴과 몸의 기묘한 분리’가 나타나는 원인이다.

가상의 얼굴이 묻다

시장조사업체 ‘나스미디어(NASMEDIA)’는 2022년 전 세계 인플루언서 마케팅 시장 규모를 150억 달러로 추산했는데, 이 중 상당 부분을 버추얼 인플루언서가 차지할 것으로 봤다. 이들을 이용한 광고, 마케팅 프로젝트가 늘어나는 이유는 무엇일까?

첫 번째는 ‘안전’이다. 버추얼 인플루언서는 제작사의 완벽한 통제 아래 있다. 음주 운전이나 마약 복용으로 광고주나 제품의 이미지에 먹칠을 하는 일도 없고, 아프거나 다쳐서 광고나 마케팅 프로젝트 일정에 차질을 주는 경우도 없다. 버추얼 인플루언서만큼 그 성실함을 신뢰할 수 있는 모델은 없다. 두 번째는 ‘자유로움’이다. 버추얼 인플루언서는 무(無)에서 창조된 인물이기 때문에 무엇에도 구애받지 않고 자유롭게 내러티브와 특징을 설정할 수 있다. 실제 인간이라면 모든 사람이 좋아하는 특징만 가지는 것은 불가능하다. 하지만 버추얼 인플루언서라면 이론상으론 가능하다. 마지막은 ‘신선함’이다. 버추얼 인플루언서는 존재 자체만으로도 소비자의 흥미를 끈다. 로지가 등장한 광고는 유튜브 공개 이후 20여 일 만에 누적 조회수 1000만 회를 기록했다.

하지만 이는 어디까지나 마케팅 차원의 이야기다. 릴 미켈라나 이마, 로지의 합성된 가상의 얼굴은 우리에게 ‘주체성(subjectivity)’과 ‘정체성(identity)’에 대한 질문을 던진다. 주체성이란 어떤 존재가 자신의 의지로서 어떤 대상에 작용하려는 자세이며, 정체성은 ‘내’가 누구인지에 대한 인식, 즉 스스로에 대한 자각이나 존재에 대한 깨달음을 말한다. 이 둘 중 버추얼 인플루언서에 있는 것은 정체성이다. 제작사들은 버추얼 인플루언서들의 정체성을 형성하는데 큰 공을 들인다. 보는 사람들이 매력을 느낄 수 있게 하기 위해서다. 그리고 거의 모든 버추얼 인플루언서들의 정체성은 ‘주체성이 있는’ 것으로 설정된다. 예를 들어 릴 미켈라의 관심사는 인권과 성 평등이며, 로지는 환경 보호에 관심이 많다. 주체적으로 무엇인가를 할 수 없는 수동적인 캐릭터에 매력을 느끼는 사람은 그렇지 않은 사람들보다 적기 때문이다. 수동적인 광고 모델을 기용해 브랜드에 주체적이지 못하다는 이미지를 덧씌우고 싶은 브랜드가 있을까?

하지만 주체성이 있다고 설정된 버추얼 인플루언서는 사실 주체성을 가질 수 없다. 주체성은 주체가 되려는 노력의 ‘역사’를 통해 확립되는 것이기 때문이다. 하지만 만들어진 가상의 얼굴에는 역사가 있다는 주장만 있을 뿐 실제 시간이 흐르며 형성된, 주체가 형성돼 온 역사가 반영될 수 없다. 사람들은 역사가 있다는 주장을 실제 역사로 받아들일 만큼 어리석지 않다. 이것이 버추얼 인플루언서들이 비록 나름의 인기를 끌고, 마케팅 분야에서 어느 정도 자리를 잡아 가고 있다고 해도 인간 인플루언서, 모델을 완전히 대체할 수 없는 이유다. 사람들은 개인의 역사 속에서 정체성과 주체성을 형성한 개체로서, 다른 사람들도 각자의 역사를 통해 비슷한 과정을 겪었다는 것을 알고 있기 때문이다. 그렇다면, 만들어진 얼굴을 가진, 버추얼 인플루언서는 역사성을 가질 수 있는 방법이 전혀 없는 것일까? 다음의 사례를 보자.

‘코드미코(CodeMiko)’는 이른바 ‘버추얼 스트리머(virtual streamer)’다. 버추얼 스트리머는 본인이 아닌, 움직이는 2D 혹은 3D 캐릭터를 통해 방송을 진행하는 인터넷 방송인을 말한다. 실제 코드미코는 한국에서 태어나 어린 시절 미국으로 이민을 간 한국계 미국 여성이지만 인터넷 방송에서는 젊은 여성 게임 캐릭터의 얼굴과 몸으로 모습을 바꿔 토크 위주의 방송을 진행한다. ‘초대형 비디오 게임에 출연하는 게 꿈인, 비디오 게임 세계에 사는 캐릭터’라는 설정이다. 코드미코는 풀 바디 모션 트래킹(full body motion tracking) 장비를 활용해 상당히 높은 수준으로 얼굴과 몸을 실시간으로 변경한다. 나름의 설정을 만들어 그대로 모습을 바꾼다는 점은 앞서 언급했던 다른 버추얼 인플루언서들과 동일하다. 하지만 다른 버추얼 인플루언서들과 코드미코의 근본적인 차이는 코드미코가 가상의 얼굴이 대체한 본인의 진짜 얼굴을 숨기지 않는다는 점이다. 라이브로 풀 바디 모션트래킹 방송을 할 때면 화장실에도 갈 수 없기 때문에 방송을 할 수 있는 시간이 4~5시간에 불과하다. 이 때문에 코드미코는 모습을 바꾼 방송을 하지 않을 때는 카메라 앞에서 실제 본인의 모습을 드러내고 방송을 진행한다. 현재 현실의 코드미코는 아예 ‘기술자(The Technician)’라는 캐릭터로 모션 트래킹 방송과 관련된 여러 기술적 이슈나 모습을 바꾼 방송을 준비하는 과정을 스트리밍한다. 코드미코의 시청자들은 코드미코가 얼굴이 바뀐 버추얼 스트리머와 실제 모습을 오가는 것에 별다른 위화감이나 불만을 느끼지 않는다.

코드미코는 버추얼 스트리머와 실제 모습을 자연스럽게 오간다. 또한 버추얼 스트리머의 방송이 어떻게 준비되는지를 시청자에게 지속적으로 보여 주면서 코드미코만의 독특한 정체성과 주체성을 확립한다. 게임 캐릭터의 얼굴이 실제의 얼굴을 완전히 지우는 게 아니라 실제 얼굴을 캐릭터의 역사성을 확립해 가는 장치로 활용하는 것이다.

이와 비견할 수 있는 우리나라의 사례는 버추얼 유튜버 ‘루이(Rui)’다. 루이는 ‘돕 스튜디오(dob Studio)’ 소속으로 여러 유명한 노래를 커버하는 영상이 주요 콘텐츠다. 루이는 몸과 목소리는 실제 사람이지만 얼굴은 딥페이크로 합성된 가상 얼굴로 활동하고 있다. 루이도 코드미코처럼 가상의 얼굴 뒤에 실제 얼굴이 있다는 것을 숨기지 않는다. 차이점은 실제 얼굴을 보여 주는 경우가 없다는 것이다. 가상의 얼굴에 대한 특별한 정체성을 설정하지 않았다는 점도 다르다. 루이는 자신이 원래부터 가수 지망생이었으며, 얼굴 등 노래가 아닌 다른 것에 구애받지 않고 즐겁고 자유롭게 음악을 하기 위해 얼굴을 바꾸고 활동한다고 말한다. 이는 본래 얼굴의 정체성과 주체성을 말하는 것이다. 이런 맥락에서 루이는 사람들에게 본인의 역사성을 강조할 필요가 없다. 대체된 가상의 얼굴을 통해 역사성이 있는, 원래의 얼굴을 드러내고 있기 때문이다.

이처럼 일부 버추얼 인플루언서, 스트리머들은 본인만의 독특한 방법으로 자신의 역사성을 드러내며 정체성과 주체성을 쌓아 가고 있다. 하지만 이러한 방법은 버추얼 인플루언서들이 마케팅 영역에서 각광 받는 이유와는 거리가 있다. 대체된 가상의 얼굴이 아닌, 원래의 얼굴을 드러낼수록 제작사의 완벽한 통제와 자유로운 설정에서 멀어지기 때문이다. 현재로서는 완벽하게 통제되고 자유롭게 설정되는 가상 얼굴이, 충분한 역사를 통해 형성되는 정체성과 주체성을 가질 수 있는 방법이 있는지 불투명하다.

이와 비견할 수 있는 우리나라의 사례는 버추얼 유튜버 ‘루이(Rui)’다. 루이는 ‘돕 스튜디오(dob Studio)’ 소속으로 여러 유명한 노래를 커버하는 영상이 주요 콘텐츠다. 루이는 몸과 목소리는 실제 사람이지만 얼굴은 딥페이크로 합성된 가상 얼굴로 활동하고 있다. 루이도 코드미코처럼 가상의 얼굴 뒤에 실제 얼굴이 있다는 것을 숨기지 않는다. 차이점은 실제 얼굴을 보여 주는 경우가 없다는 것이다. 가상의 얼굴에 대한 특별한 정체성을 설정하지 않았다는 점도 다르다. 루이는 자신이 원래부터 가수 지망생이었으며, 얼굴 등 노래가 아닌 다른 것에 구애받지 않고 즐겁고 자유롭게 음악을 하기 위해 얼굴을 바꾸고 활동한다고 말한다. 이는 본래 얼굴의 정체성과 주체성을 말하는 것이다. 이런 맥락에서 루이는 사람들에게 본인의 역사성을 강조할 필요가 없다. 대체된 가상의 얼굴을 통해 역사성이 있는, 원래의 얼굴을 드러내고 있기 때문이다.

이처럼 일부 버추얼 인플루언서, 스트리머들은 본인만의 독특한 방법으로 자신의 역사성을 드러내며 정체성과 주체성을 쌓아 가고 있다. 하지만 이러한 방법은 버추얼 인플루언서들이 마케팅 영역에서 각광 받는 이유와는 거리가 있다. 대체된 가상의 얼굴이 아닌, 원래의 얼굴을 드러낼수록 제작사의 완벽한 통제와 자유로운 설정에서 멀어지기 때문이다. 현재로서는 완벽하게 통제되고 자유롭게 설정되는 가상 얼굴이, 충분한 역사를 통해 형성되는 정체성과 주체성을 가질 수 있는 방법이 있는지 불투명하다.

[1]

Joseph Ayerle VideoArt, 〈Un'emozione per sempre 2.0: starring Ornella Muti〉, 2018. 3. 24.

[2]

조셉 아이얼이 제공한 작품 설명 직접 인용.

[3]

Katerina Cizek , William Uricchio and Sarah Wolozin. 〈PART 6: MEDIA CO-CREATION WITH NON-HUMAN SYSTEMS〉. Collective Wisdom.

[4]

1955년 존 매카시(John McCarthy)가 ‘인공지능’이란 말을 만들었다. 1958년, 프랭크 로젠블랏(Frank Rosenblatt)이 현재 인공신경망 기술의 기반을 놓은 ‘퍼셉트론(Perceptron)’을 개발했다.

[5]

Ada Lovelace, 〈Sketch of The Analytical Engine Invented by Charles Babbage>, 《Bibliothèque Universelle de Genève》, 82, 1842.

[6]

Katerina Cizek , William Uricchio and Sarah Wolozin. 〈PART 6: MEDIA CO-CREATION WITH NON-HUMAN SYSTEMS〉. Collective Wisdom.

[7]

https://thispersondoesnotexist.com/

[8]

안상현, 〈“화성, 걷는다, 광각” 입력하자 20초만에 잡지 표지가…〉, 《조선일보》, 2022. 11. 3.

[9]

TIMEREK RU, 〈МегаФон Брюс Уиллис〉, 2021. 8. 17.

[10]

Joshua Rothkopf, 〈Deepfake Technology Enters the Documentary World〉, 《The New Times》, 2020. 7. 1.

[11]

Joshua Rothkopf, 〈Deepfake Technology Enters the Documentary World〉, 《The New Times》, 2020. 7. 1.

[12]

Benji Edwards, 〈Bruce Willis denies selling deepfake rights to Deepcake [Updated]〉, Ars Technica, 2022. 10. 4.

[13]

Bea Mitchell, 〈Disney’s deepfake technology could be used in film and TV〉, 《blooloop》, 2020. 7. 21.

[14]

Steve Williams and Joe Letteri, 〈Jurassic Park - The Illusion of Life〉, Silicon Valley ACM Siggraph, 1994.

[15]

EZRyderX47, 〈Robert Downey Jr and Tom Holland in Back to the future - This is heavy! [deepfake]〉, 2020. 2. 15.

[16]

강경희, 〈서울 출생, 나이는 영원히 22세… 가상인간 로지의 탄생비화〉, 《조선일보》, 2021. 8. 6.